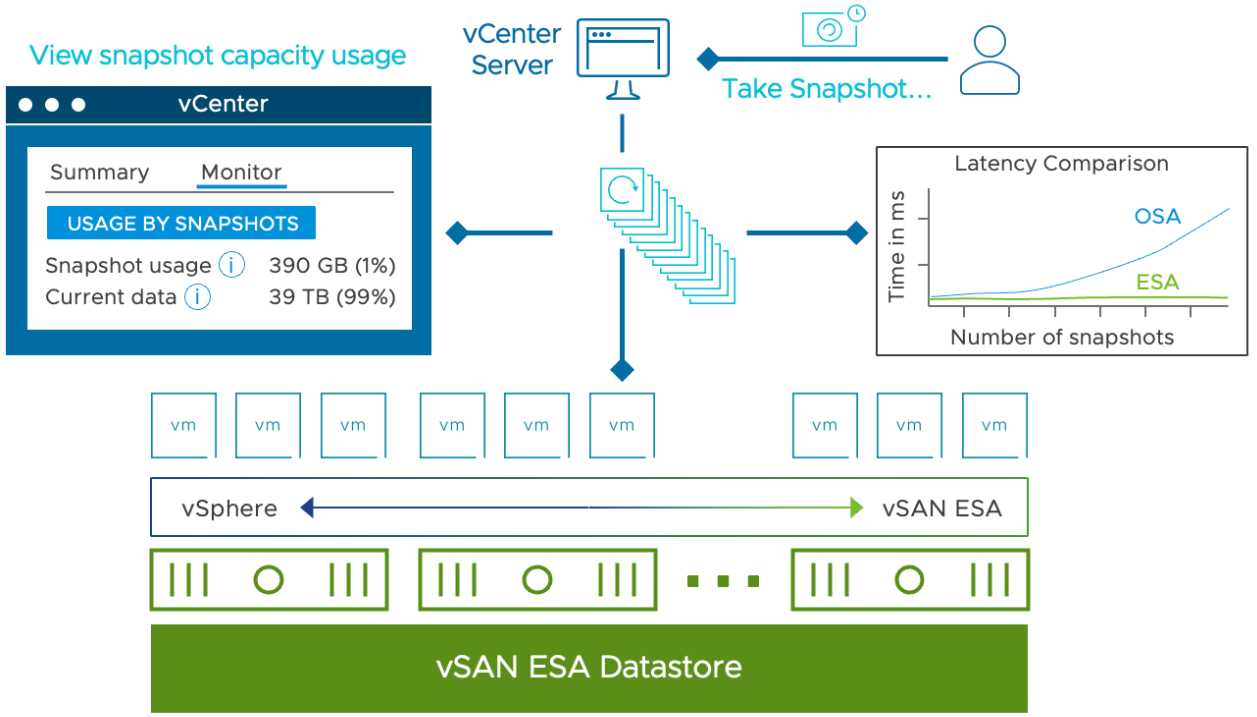

最新举办的VMware Explore 2022大会中,正式发布最新的vSphere 8和vSAN 8版本。 vSAN 8版本最大的改变,便是新增支持vSAN ESA(Express Storage Architecture)储存架构,而过去管理人员熟悉的vSAN超融合技术则为vSAN OSA(Original Storage Architecture)储存架构。

新增支持的vSAN ESA储存架构,仅支持高性能的NVMe储存装置,至于其他SATA或SAS SSD固态硬盘储存装置则不支持,在vSAN储存网络部分则建议至少配置25Gbps传输速率。 或许管理人员会有这样的疑惑,过去的vSAN架构也支持采用NVMe储存装置建构出All-Flash模式的vSAN超融合丛集,那么新增支持的vSAN ESA储存架构究竟有何不同?

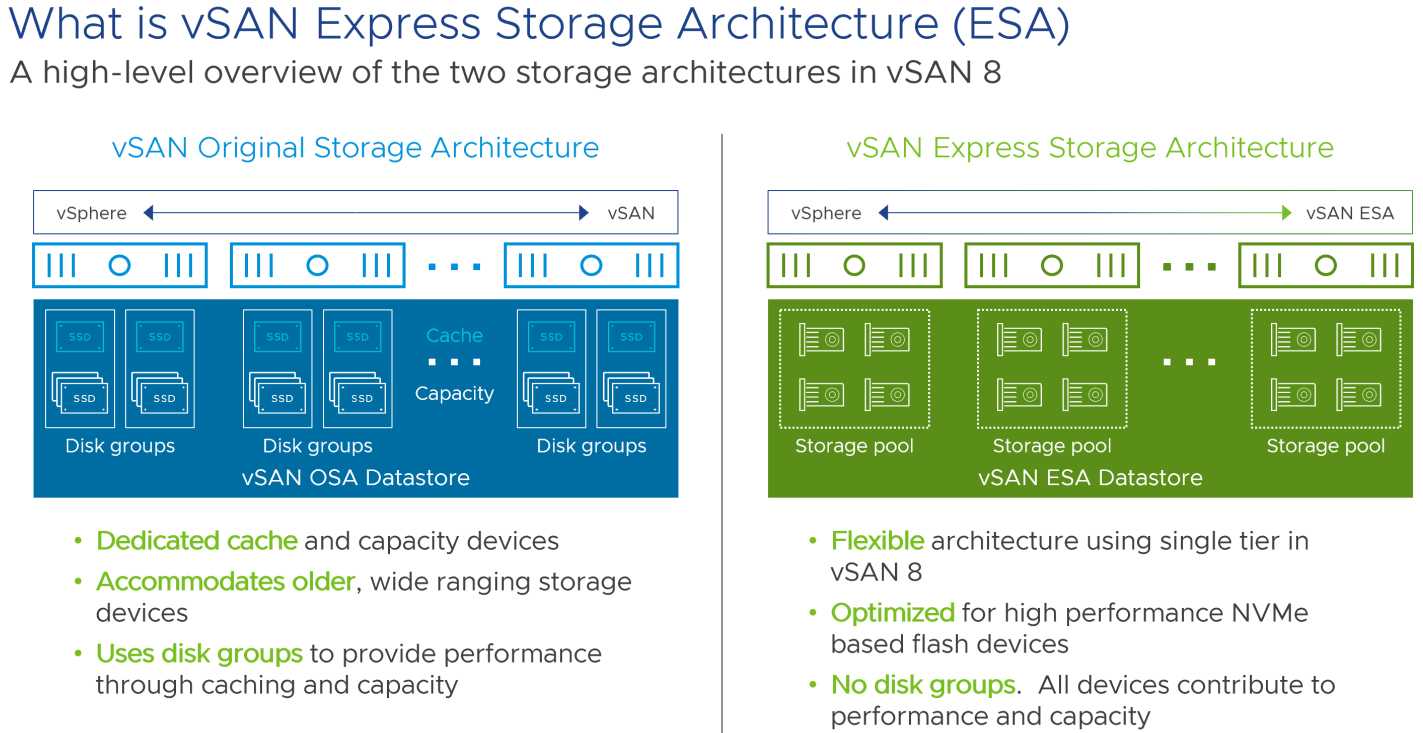

简单来说,传统的vSAN OSA存储架构,先将存储设备区分为「快取层」(Cache Tier)和「容量层」(Capacity Tier),并将快取层和容量层组合为「磁盘群组」(Disk Group),其中快取层仅用于数据快取和写入使用,并无法真正纳入储存容量,而新式的vSAN ESA储存架构,则采用单一储存层级并导入「储存集区」 (Storage Pool)机制,所有NVMe存储设备容量都能使用,如图1所示。

图1 传统vSAN OSA和新式vSAN ESA存储架构比较示意图。 (图片来源:Announcing VMware vSAN 8 | VMware Virtual Blocks Blog)

值得注意的是,必须使用至少「vSAN Advanced」或更高的软件授权版本,才能够支持使用新式的vSAN ESA储存架构,若仅采购vSAN Standard软件授权,虽然使用最新的vSAN 8版本,也仅支持构建传统vSAN OSA储存架构的超融合丛集。 详细软件授权和功能支持信息,可参考VMware vSAN Licensing Guide文档。

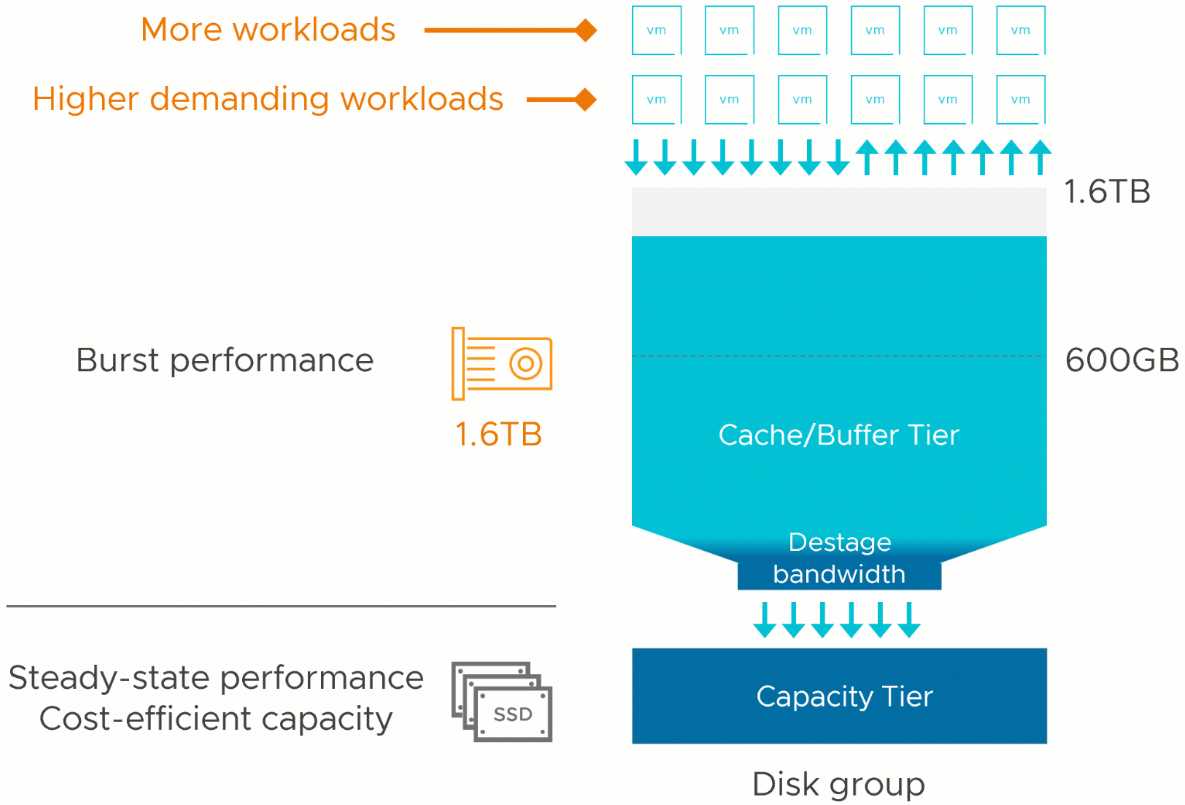

虽然vSAN 8推出新式ESA储存架构,但针对传统的OSA储存架构也有所提升。 在过去的vSAN OSA储存架构中,每个磁盘群组的「写入缓冲大小」(Write Buffer Size)为「600GB」,表示每个磁盘群组中最多仅能宣告使用600GB储存空间,所以大于此限制的快取层储存空间便无法有效利用。

最新的vSAN 8版本OSA储存架构,将写入缓冲大小提升至「1.6TB」,这表示OSA储存架构能够更提升数据读取和写入效能,因为可以储存的读取缓存和写入缓冲区的资料量变多了,同时也可以减少容量层的I/O需求,以及vSAN元件的重新同步时间,如图2所示。

图2 vSAN 8 OSA储存架构写入缓冲大小由600GB提升至1.6TB。 (图片来源:Increased Write Buffer Capacity for the vSAN 8 Original Storage Architecture | Vmware)

一、vSAN 8 ESA存储架构亮眼特色功能介绍

事实上,最新版本的vSAN 8 ESA储存架构,并非仅是支持NVMe储存装置和采用存储集区,而是从底层许多技术进行增加及改进,与传统vSAN OSA储存架构相较下,更能充分发挥NVMe储存装置的效能。

RAID-5/6 vs RAID-1

在传统vSAN OSA储存架构中,若希望节省储存空间,则采用RAID-5/6容错机制,保护VM虚拟主机工作负载的vSAN元件,缺点是储存效能稍嫌不足,而若是希望获得较高的储存效能,可以采用RAID-1容错机制,但缺点是消耗较多的储存空间,而新式vSAN ESA储存架构,则采用RAID-5/6容错机制, 不但能提供不输给RAID-1的存储效能,还可以在存储效能和节省存储空间之间达到最大化。

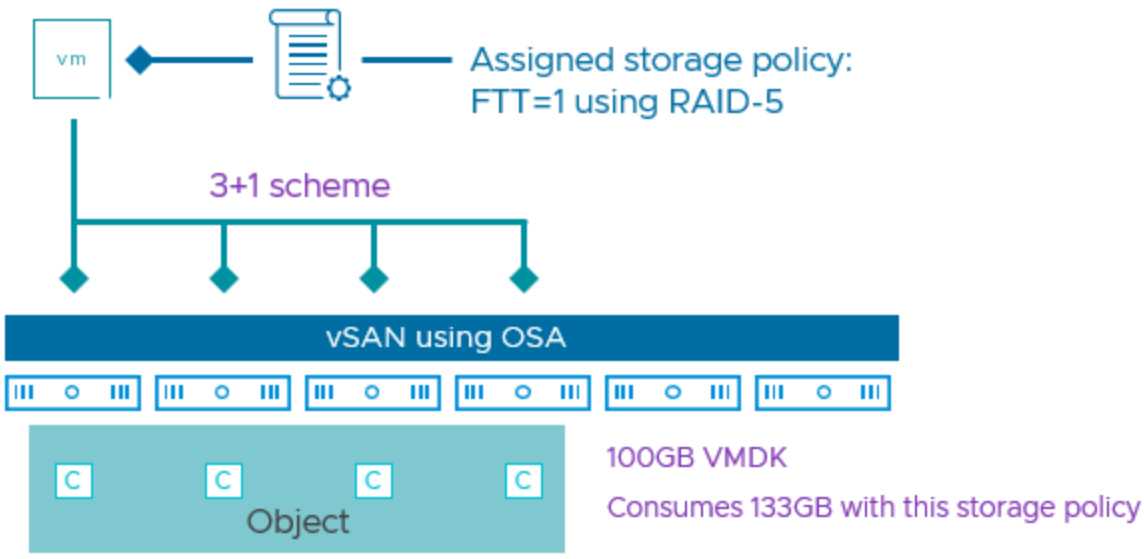

此外,同样采用RAID-5容错机制,传统vSAN OSA储存架构和新式vSAN ESA储存架构,在储存空间节省方面也所有不同。 在传统vSAN OSA储存架构中,提供3+1的RAID-5容错机制,这表示保护数据的方式是由3个「资料位」(Data bits)加上1个「同位位」(Parity bit)组成,所以至少必须要跨越「4台」vSAN丛集节点主机,才能达到数据保护的目的,并且能够容忍单台vSAN丛集节点主机发生故障,储存容量则是主要资料的「1.33倍」, 当VM虚拟主机的VMDK硬盘大小为100GB时,则需要耗用133GB的vSAN储存空间,如图3所示。

图3 传统vSAN OSA储存架构3+1的RAID-5容错机制示意图。 (图片来源:Adaptive RAID-5 Erasure Coding with the Express Storage Architecture in vSAN 8 | Vmware)

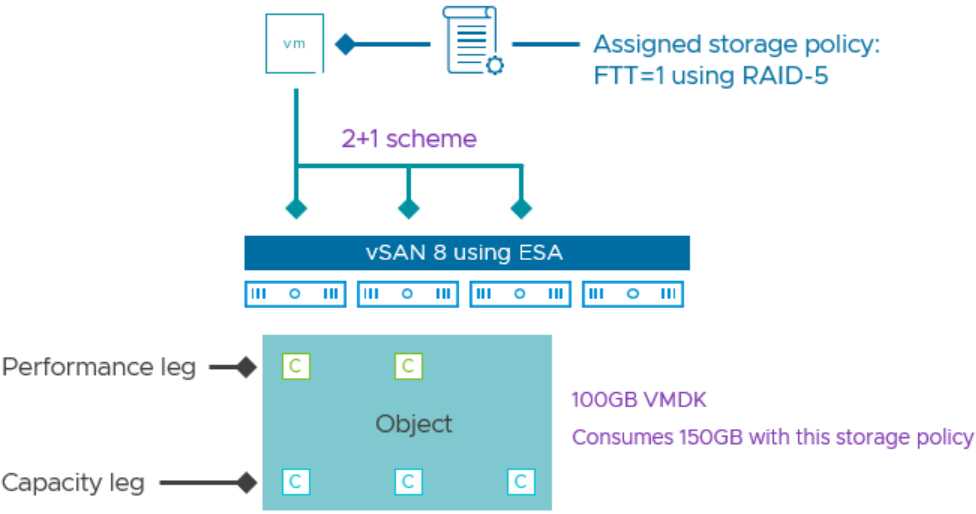

新式的vSAN ESA储存架构则提供两种不同的RAID-5容错机制,当vSAN丛集节点主机数量较少时,可以采用FTT=1的2+1 RAID-5容错机制,也就是2个「资料位」(Data bits)加上1个「同位位」(Parity bit)组成,只要跨越「3台」vSAN丛集节点主机就能达到资料保护的目的,储存容量则是主要资料的「1.5倍」 ,如果VM虚拟主机的VMDK硬盘大小为100GB,则须耗用150GB的vSAN储存空间,如图4所示。

图4 新式vSAN ESA存储架构FTT=1的2+1 RAID-5容错机制示意图。 (图片来源:Adaptive RAID-5 Erasure Coding with the Express Storage Architecture in vSAN 8 | Vmware)

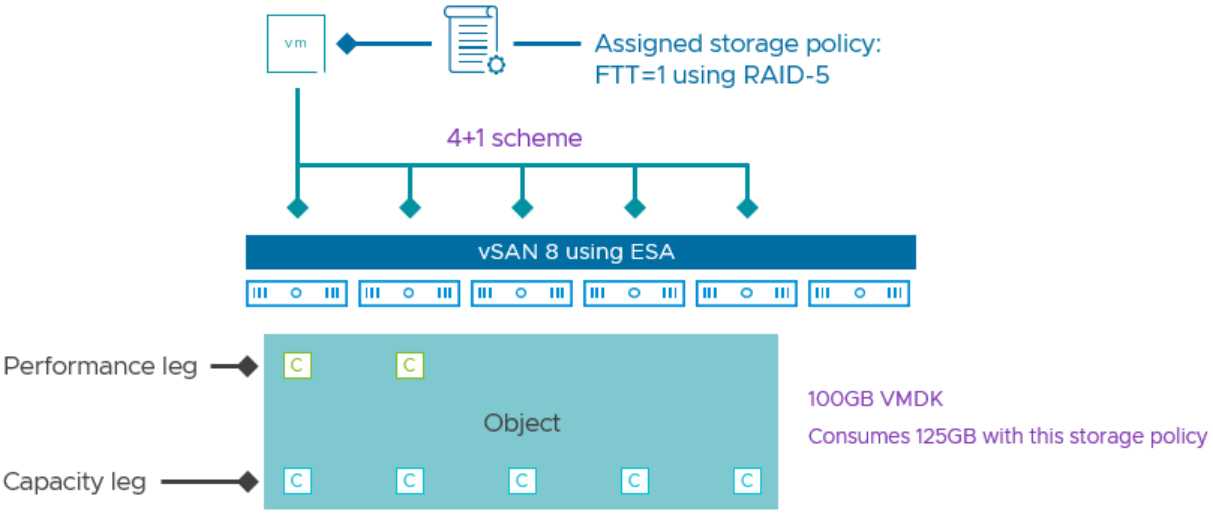

倘若vSAN丛集节点主机数量较多时,可以采用FTT=1的4+1 RAID-5容错机制,也就是4个「资料位」(Data bits)加上1个「同位位」(Parity bit)组成,必须跨越「5台」vSAN丛集节点主机才能达到数据保护的目的,储存容量则是主要数据的「1.25倍」,如果VM虚拟主机的VMDK硬盘大小为100GB, 则仅需要耗用125GB的vSAN储存空间,如图5所示。

图5 新式vSAN ESA存储架构FTT=1的4+1 RAID-5容错机制示意图。 (图片来源:Adaptive RAID-5 Erasure Coding with the Express Storage Architecture in vSAN 8 | Vmware)

增强压缩机制

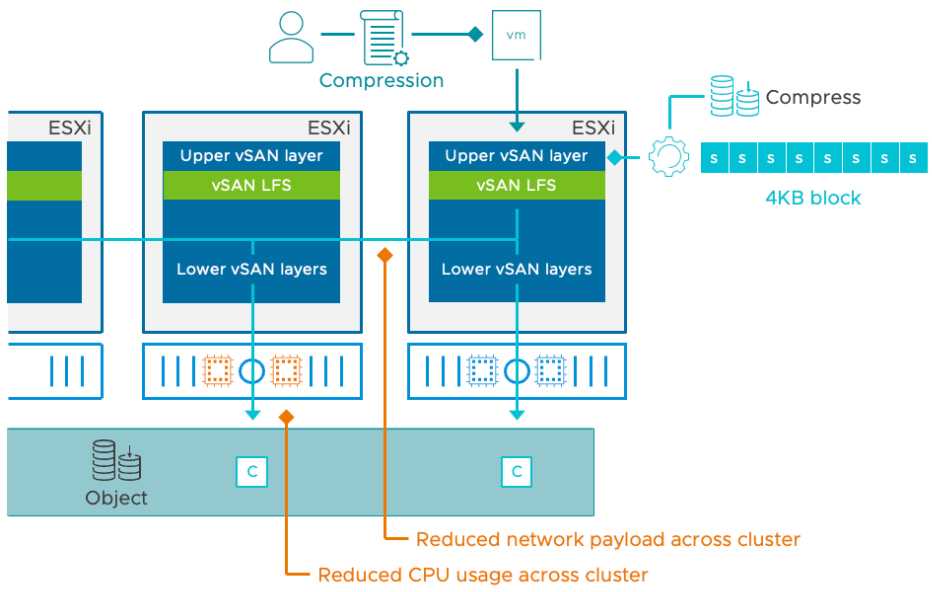

在最新vSAN 8 ESA超融合技术中,针对数据压缩机制重新设计并增强处理效能,在数据写入压缩方面,只需要针对主要数据压缩一次即可,而非每个数据副本也要进行压缩,此举除了有效降低CPU处理器的工作负载外,同时也降低写入数据量和vSAN储存流量,而在数据读取方面,则直接读取压缩状态的数据,无须解压缩后进行读取, 同样减少vSAN丛集节点主机之间的vSAN储存流量。

具体来说,新的压缩机制将数据大小的压缩单元缩小到4KB,整体压缩比达到8:1,与传统vSAN OSA储存架构相比提升了4倍,如图6所示。

图6 新式vSAN 8 ESA储存架构压缩机制运作示意图。 (图片来源:vSAN 8 Compression - Express Storage Architec

ure | Vmware)

智能调整vSAN网络流量

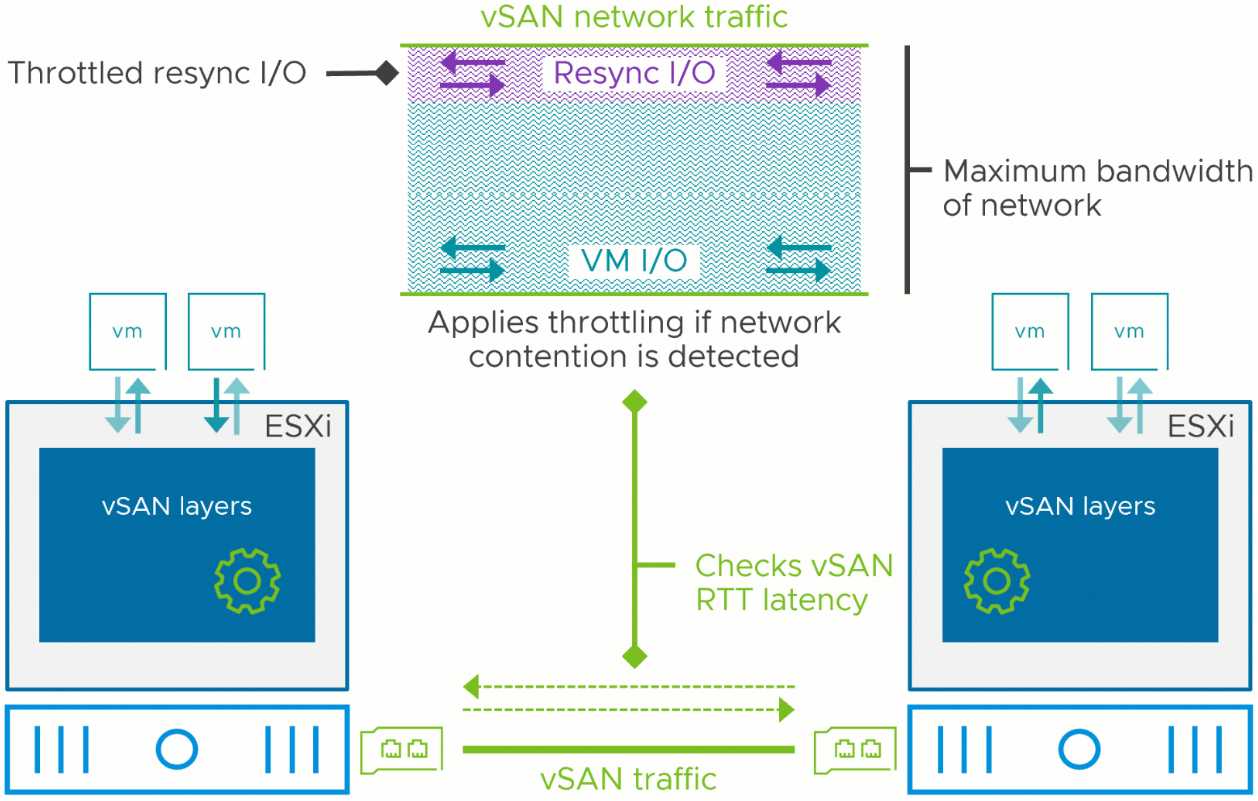

在传统的vSAN OSA储存架构中,倘若vSAN储存流量发生资源争夺的情况,例如VM虚拟主机I/O工作负载,与重新同步元件的Resync I/O工作负载同时发生时,便很有可能因为资源争夺的情况而造成vSAN储存效能降低,甚至影响VM虚拟主机的工作负载。 新式的vSAN ESA储存架构,新增智能家居SAN网络流量调整机制,在vSAN储存流量没有发生资源争夺时,每种类型的vSAN流量都可以尽可能使用网络带宽,一旦发生资源争夺的情况,便会自动检测并限制优先层级较低的vSAN流量。

因此,同样发生上述的vSAN储存流量发生资源争夺时,新式的vSAN ESA储存架构将会把重新同步元件的Resync I/O工作负载,限制在使用网络带宽不超过20%,而让优先层级较高的VM虚拟主机I/O工作负载,能够使用80%的网络带宽,如图7所示。

图7 新式vSAN ESA存储架构智能家居SAN网络流量调整机制示意图。 (图片来源:Adaptive Network Traffic Shaping with the vSAN Express Storage Architecture | Vmware)

B-Tree高效能快照机制

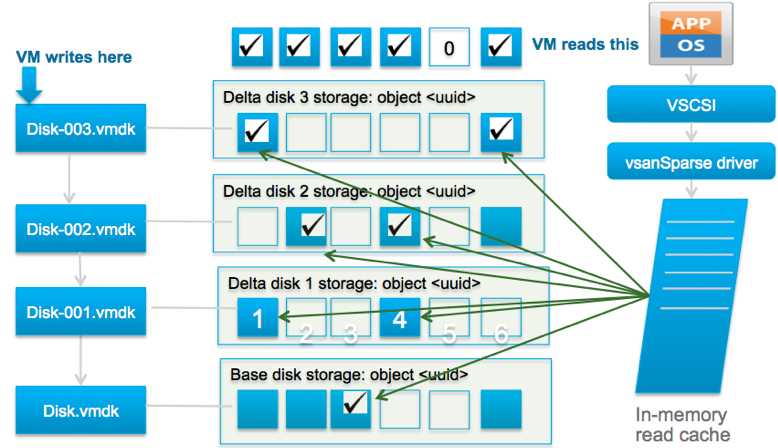

过往的vSAN版本中,虽然针对VM虚拟主机工作负载的「快照」(Snapshot)不断改善,例如vSAN 5.5版本的VMFS快照以及vSAN 6.0的vsanSparse快照机制都是为了增强和改善快照效能,然而长时间储存的快照合并作业一直是个难解的问题,如图8所示。

图8 传统vSAN储存架构快照机制运作示意图。 (图片来源:Scalable, High-Performance Native Snapshots in the vSAN Express Storage Architecture | Vmware)

新式vSAN ESA储存架构,处理快照时并非采用传统vDisk虚拟硬盘的互相参照机制,而是改为采用B-Tree的方式处理,相较于过去传统的快照机制,在删除快照时间上,B-Tree新式机制比传统快上「100倍」,有效改善快照处理时间,如图9所示。

图9 新式vSAN ESA储存架构改采用B-Tree机制处理快照示意图。 (图片来源:Scalable, High-Performance Native Snapshots in the vSAN Express Storage Architecture | Vmware)

二、实战vSAN 8 ESA超融合丛集

接下来将实作演练最新vSAN 8 ESA超融合储存架构,除了采用最新vCenter Server 8管理平台外,共有3台vSAN丛集节点主机,每台vSAN丛集节点主机,除了安装ESXi虚拟化平台系统的硬盘外,还额外配置4颗600GB NVMe储存装置。

手动建立DataCenter和Cluster

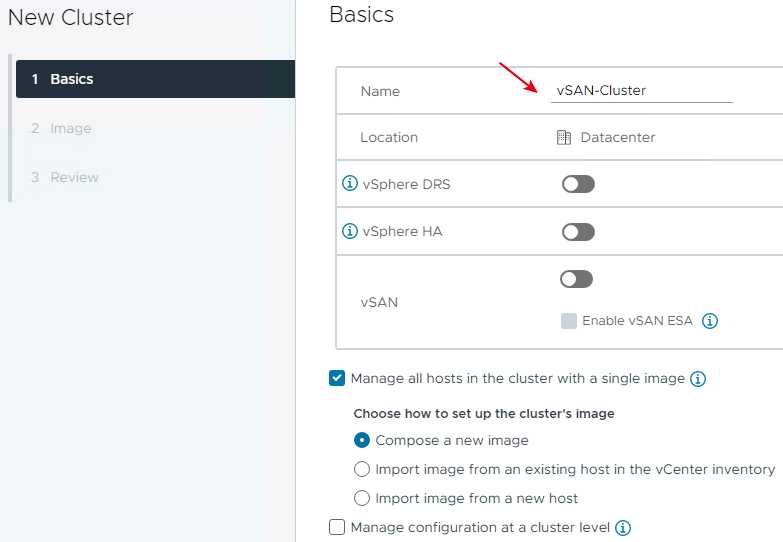

在本文实作环境中,不会采用Cluster QuickStart自动化部署机制,而是改为采用手动操作逐一建立的方式,例如手动建立DataCenter、Cluster、vDS分布式虚拟交换器、vSAN VMkernel Port等等,以便带领大家能够一步一步打造出vSAN ESA超融合丛集。

首先登入vCenter Server 8管理平台,然后建立vSAN 8 ESA超融合丛集使用的DataCenter和Cluster。 值得注意的是,在建立vSAN Cluster时先建立空的丛集而不要启用任何进阶特色功能,例如vSphere DRS、vSphere HA、vSAN,等到后续运作环境完备,再启用这些丛集等级的进阶特色功能,如图10所示。

图10 建立vSAN-Cluster但先不启用丛集等级的进阶特色功能。

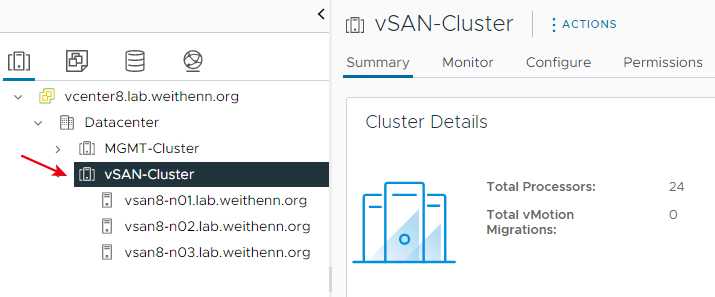

在管理界面中,依序点选「vCenter Server > DataCenter > vSAN-Cluster > Actions > Add Hosts」,键入第1台vSAN丛集节点主机的连线信息后按下〔Add Host〕按钮,接着勾选上方的「Use the same credentials for all hosts」, 表示采用相同的管理者账号和密码,纳管3台vSAN丛集节点主机,按下〔Next〕按钮后,系统将会自动弹出这3台vSAN丛集节点主机的SHA1指纹文件内容,按下〔OK〕按钮接受后至下一个纳管步骤。

在2. Host Summary纳管步骤中,确认vSAN丛集节点主机信息无误后按下〔Next〕按钮,在3. Import Image纳管步骤中,采用默认值Don't import an image选项即可,最后在4. Review步骤中确认正确后按下〔Finish〕按钮,即可将3台vSAN丛集节点主机加入至vSAN-Cluster丛集中,如图11所示。 默认情况下加入的vSAN丛集节点主机,将会自动进入「维护模式」(Maintenance Mode),管理人员可以将其设定为离开维护模式。

图11 将3台vSAN丛集节点主机加入至vSAN-Cluster纳管。

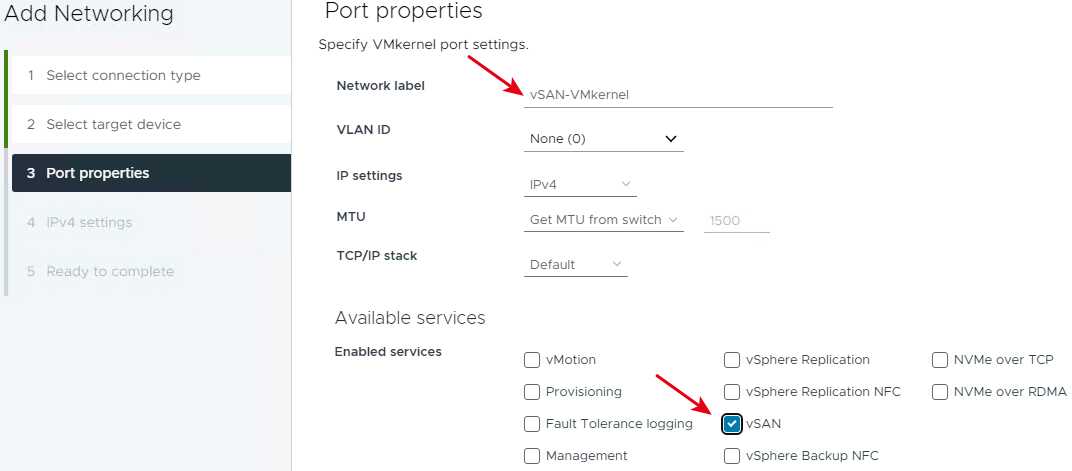

配置vSAN VMkernel Port

在vSAN超融合运作架构中,每台vSAN丛集节点主机必须规划专用于vSAN储存流量的VMkernel Port,确保vSAN超融合丛集中每台vSAN丛集节点主机,都能够透过这个专用的vSAN储存流量VMkernel Port,彼此交换和储存相关vSAN元件。

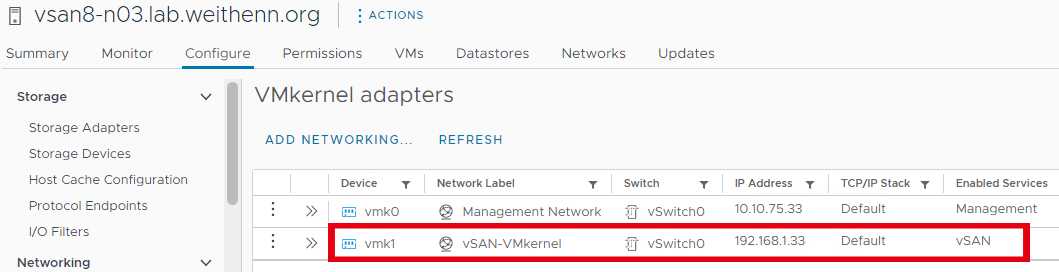

点击「vSAN8-N01」,这是本文实作环境中规划的第1台vSAN丛集节点主机,然后依序点选「Configure > Networking > VMkernel adapters > Add Networking」选项,在弹出窗口中选择「VMkernel Network Adapter」项目后按下〔Next〕按钮。 在2. Select target device页面中,先选择将vSAN VMkernel Port建立在预设现有的vSS标准式虚拟交换器vSwitch0上,稍后将会建立vDS分布式虚拟交换器,并且将vSAN VMkernel Port迁移至vDS Port Group中。 选择「Select an existing standard switch > vSwitch0」选项后,按下〔Next〕按钮。

在3. Port properties页面中,于Network label字段中填入「vSAN-VMkernel」名称,以利后续管理上辨别用途。 接着,在下方Enabled services选项中勾选「vSAN」项目,确保启用vSAN储存流量并按下〔Next〕按钮,如图12所示。

图12 命名为vSAN-VMkernel并勾选vSAN选项确保启用vSAN储存流量。

在4. IPv4 settings页面中,组态设定此vSAN VMkernel Port的IP地址,本文实作采用「192.168.1.31/24」,按下〔Next〕按钮,进入5. Ready to complete页面,检视相关信息确认无误后按下〔Finish〕按钮即可。 接着,采用相同的操作步骤,为vSAN8-N02和vSAN8-N03配置vSAN VMkernel Port,并且指派采用「192.168.1.32、192.168.1.33」的IP地址,如图13所示。

图13 配置另外2台vSAN丛集节点主机的vSAN VMkernel Port。

建立vSAN专用vDS分布式虚拟交换器

虽然采用vSS标准式虚拟交换器也能够构建和部署vSAN超融合丛集,然而对于后续维运管理及配置的便利性则稍嫌不足,并且针对vSAN超融合丛集的可扩展性考量,若采用vSS标准式虚拟交换器,当后续需要加入新的vSAN丛集节点主机至vSAN超融合丛集时,将会多出许多额外的配置工作,浪费管理人员宝贵的时间。

因此,在构建和部署vSAN超融合丛集初期,便建立vSAN专用的vDS分布式虚拟交换器为佳。 在vCenter Server管理界面中,依序点选「Home > Networking > vCenter Server > Datacenter > Actions > Distributed Switch > New Distributed Switch」选项,在弹出的精灵窗口中,首先于Name字段键入” vSAN-DSwitch」,然后按下〔Next〕按钮。

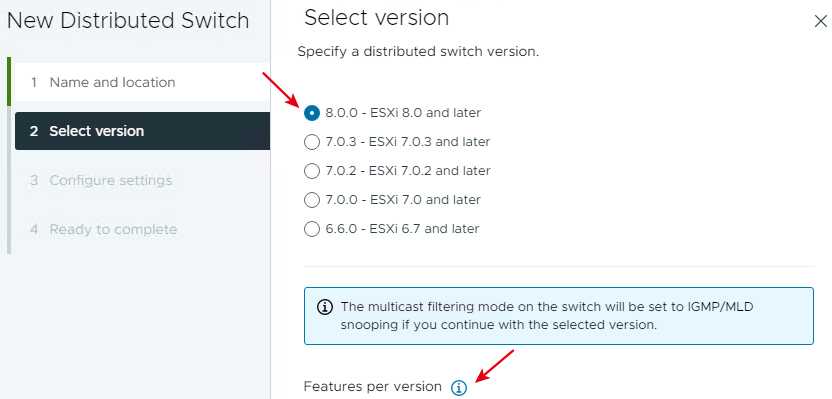

在2. Select version页面中,选择vDS分布式虚拟交换器采用的版本,在本文实作环境中采用最新的「8.0.0」版本,如图14所示。 实务上,管理人员必须视管理的vSphere虚拟化环境版本选择,举例来说,如果原有运作的vSphere丛集中采用7.0.2版本并且尚未升级至新版,那么应该为了兼容性考量,同样采用旧版的7.0.2版本,后续再找机会进行vDS版本升级作业。

在3. Configure settings页面中,大部分选项采用系统默认值即可,而在Port group name字段中键入「vSAN-DPortGroup」名称,以利后续维运管理时进行辨别。 在4. Ready to complete页面中,则确认相关信息无误后按下〔Finish〕按钮。

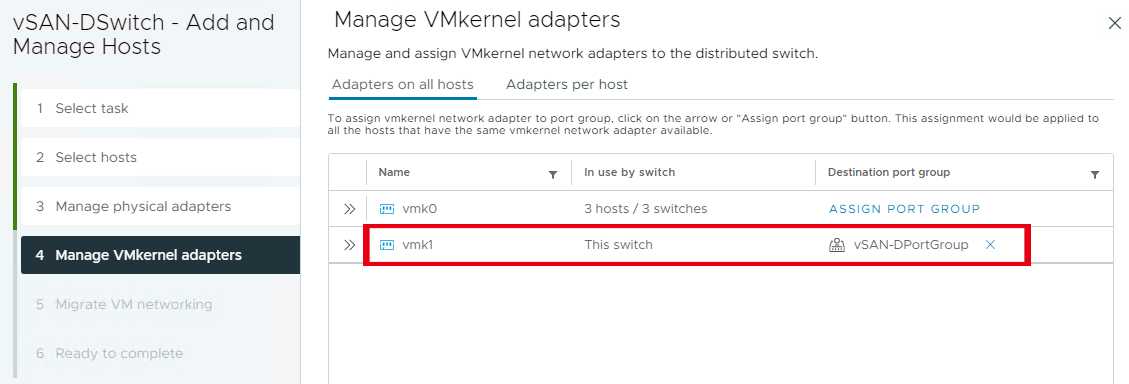

vDS分布式虚拟交换器建立完成后,便可以将3台vSAN节点主机加入,以及进行vSAN VMkernel Port迁移作业。 在vCenter Server管理界面中,依序点选「Networking > Datacenter > vSAN-DSwitch > Actions > Add and Manage Hosts」选项,在弹出的精灵窗口1. Select task页面中,选择「Add hosts」选项后按下〔Next〕按钮。 在2. Select hosts页面中,将会列出DataCenter中所有的ESXi主机,仅勾选3台vSAN丛集节点主机即可,再按下〔Next〕按钮。

在3. Manage physical adapters页面中,本文实作中的每台vSAN丛集节点主机,共配置2张10Gb网络卡,其中vmnic0用于管理和迁移等流量,而vmnic1则配置为专用于vSAN储存网络,所以在vmnic1的Assign uplink下拉选单中选择「Uplink1」,当确认选择vmnic1为Uplink1时,则原有In use by switch字段值,将从原本的3 hosts / 0 switches转变为「This switch」,表示vmnic1实体网络卡,已经指派给vDS分布式虚拟交换器使用。

在4. Manage VMkernel adapters页面中,将显示每台vSAN丛集节点主机的VMkernel Port,在本文实作中,每台vSAN丛集节点主机有2个VMkernel Port,vmk0用于管理和迁移用途,而vmk1则是刚才所建立、专用于vSAN储存流量的VMkernel Port,可以点击vmk1进行再次确认, 确认后点选Destination port group字段中的ASSIGN PORT GROUP文字,系统便会跳至是否将vmk1指派至vDS分布式虚拟交换器中的vSAN-DPortGroup,按下〔ASSIGN〕确认指派。 回到页面中,vmk1的In use by switch字段值为「This switch」,而Destination port group字段则是「vSAN-DPortGroup」,也就是将原本在vSwitch0标准式虚拟交换器中的vSAN VMkernel Port,迁移至vDS分布式虚拟交换器中的vSAN-DPortGroup,如图15所示。

图15 将vSAN VMkernel Port从vSS标准式虚拟交换器迁移至vDS分布式虚拟交换器。

在5. Migrate VM networking页面中,因为目前的vSAN超融合丛集中并没有任何VM虚拟主机网络,所以无须迁移任何VM虚拟主机网络设定,直接按下〔Next〕按钮。 在6. Ready to complete页面中,则确认相关配置设定信息,若无误则按下〔Finish〕按钮完成配置作业。

启用vSAN ESA超融合丛集

vSAN丛集节点主机和运作环境前置作业完成后,在vCenter Server管理界面,依序点选「vSAN-Cluster > Configure > vSAN > I need a local vSAN datastore > Standard vSAN cluster > Configure」选项。

在弹出的向导窗口1. vSAN ESA页面中,首先启用上方的「vSAN ESA」选项,在这个程序中,系统将进行二个项目的检查作业,首先是采用的NVMe储存装置是否为VMware certified,第二项检查则是确认vSAN丛集节点主机采用的网络卡传输速率,在VMware vSAN最佳建议作法中,专用于vSAN储存网络的网络卡传输速率,建议至少为「25 Gbps」。

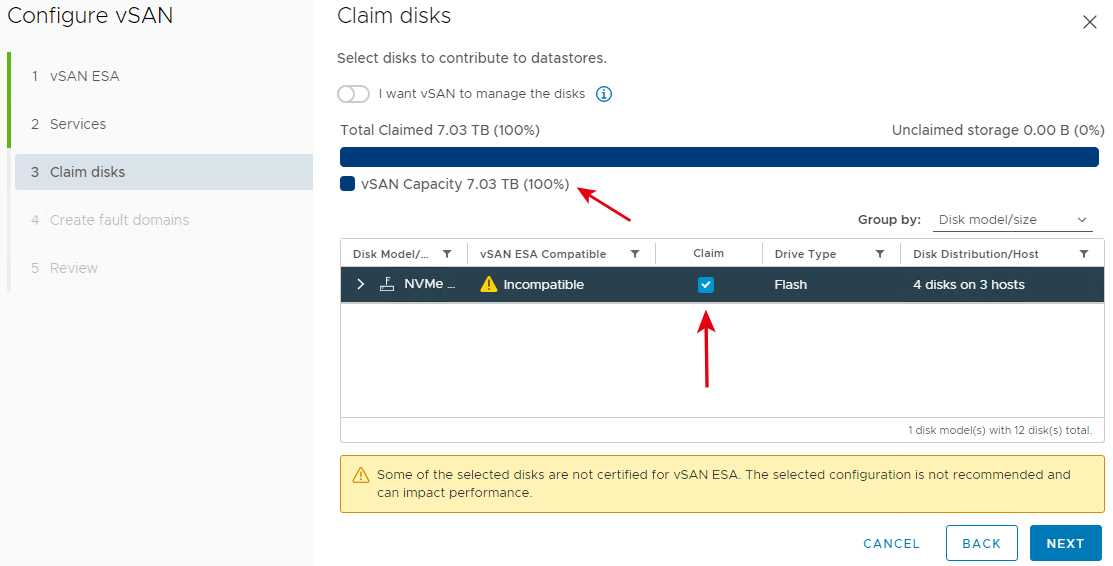

在2. Service页面中,倘若vSAN丛集节点主机采用的网络卡支持RDMA特色功能,记得勾选RDMA support项目。 在3. Cliam disks页面中,因为本文实作采用的NVMe存储装置型号尚未取得VMware Certified,所以vSAN ESA Compatible兼容性检查字段值为「Incompatible」,但是并不影响实作演练的进行,勾选「Cliam」项目表示使用所有vSAN丛集节点主机中的NVMe储存装置,勾选后上方便会显示vSAN Capacity 7.03TB,表示3台vSAN丛集节点主机、共12颗600GB NVMe储存装置皆正确无误宣告给vSAN超融合丛集使用,如图16所示。

图16 成功宣告所有NVMe存储装置给vSAN超融合丛集使用。

在4. Create fault domains页面中,采用系统默认值即可。 在5. Review页面中,则确认相关配置设定信息,若无误按下〔Finish〕按钮,完成配置作业。

管理人员可以从下方Recent Tasks工作栏中看到系统建构vSAN超融合丛集的工作流程,其中Reconfigure vSAN cluster项目是整个建构进度百分比,中间会有许多组态设定程序,例如Reconfigure cluster和Update vSAN configuration, 最后则是将每台vSAN丛集节点主机中的NVMe储存装置,加入至vSAN ESA超融合丛集中的储存集区Add disk(s) to storage pool等等工作项目。

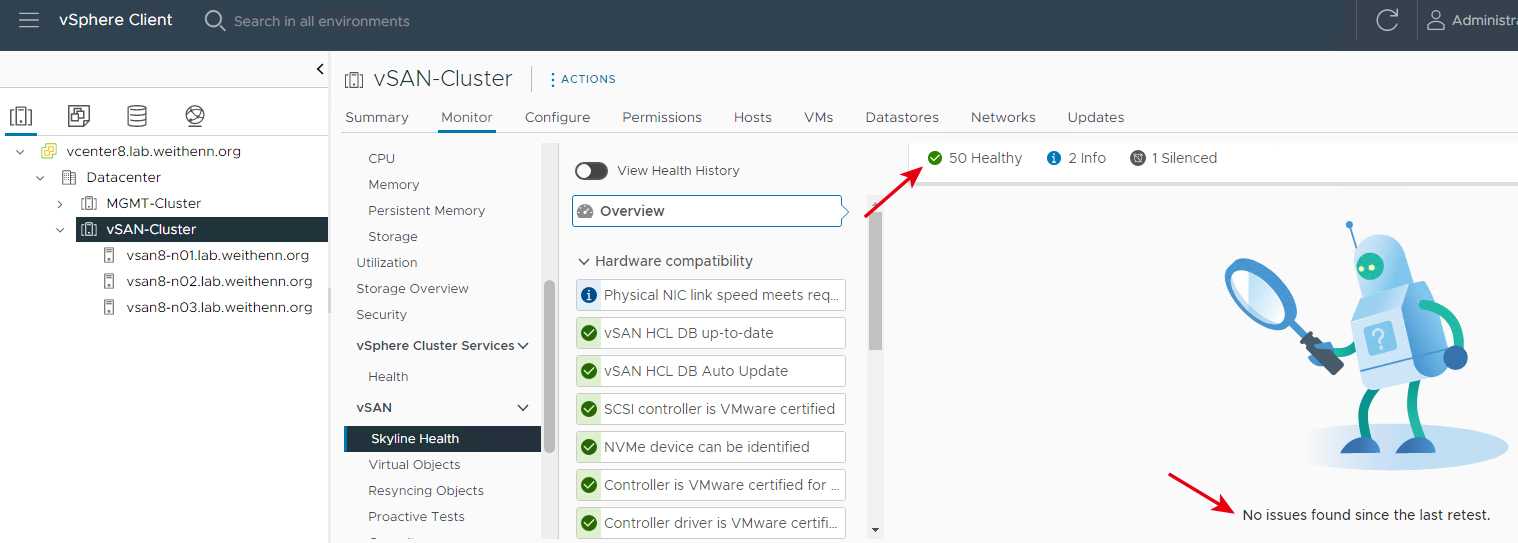

当vSAN ESA超融合丛集建构完成后,可以切换至「vSAN-Cluster > Monitor > vSAN > Skyline Health」,查看系统针对vSAN ESA超融合丛集的健康检查情况,可以看到通过所有的健康检查项目,如图17所示。

图17 顺利建构vSAN ESA超融合丛集并通过所有健康检查项目。

建立VM虚拟主机和vSAN网络测试

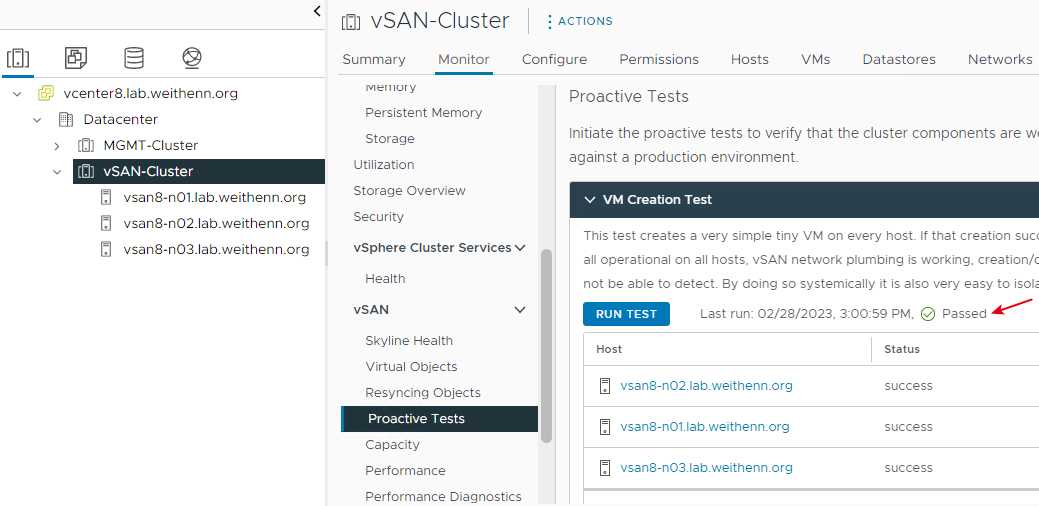

顺利构建vSAN ESA超融合丛集后,在正式上线运营并提供服务之前,建议采用内建的「主动测试」(Proactive Tests)功能,测试vSAN ESA超融合集群在建立VM虚拟主机工作负载,以及在vSAN储存网络方面是否符合需求。

在vCenter Server管理界面中,依序点选「vSAN-Cluster > Monitor > vSAN > Proactive Tests > VM Creation Test > Run Test」,此时系统将会弹出窗口,说明建立VM虚拟主机工作负载测试程序的一些事宜,确认开始测试后按下〔Run〕按钮。

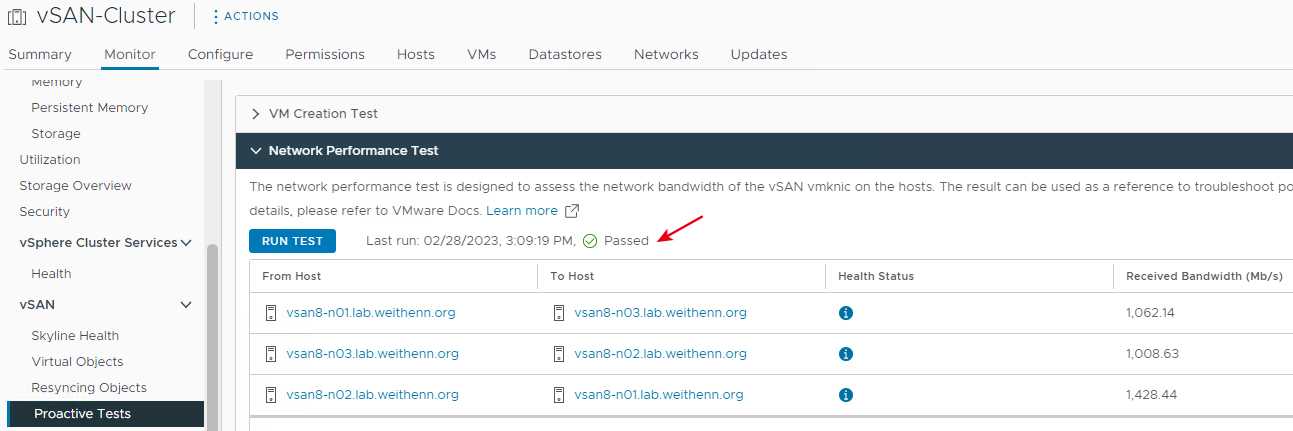

此时,在下方工作栏中可以看到系统自动在每台vSAN丛集节点主机中,建立VM虚拟主机然后再删除VM虚拟主机。 通过测试后,便会在页面中显示每台vSAN丛集节点主机的测试情况为success,以及整体测试情况为通过测试的Passed,如图18所示。 接着,展开Network Performance Test项目后,同样按下〔Run Test〕按钮进行vSAN储存网络测试,系统将会弹出窗口,说明vSAN储存网络测试程序的一些事宜,确认开始测试后按下〔Run〕按钮。 从测试结果中可以看到,vSAN集节点主机之间的vSAN存储网络传输速率和测试情况,如图19所示。

文章评论